In den letzten zwei Jahren haben Unternehmen KI für Unternehmen größtenteils als Ebene implementiert, die Inhalte generiert — Text, Code, Zusammenfassungen und Empfehlungen. Bei den meisten Produkten befinden sich diese Funktionen auf der Benutzeroberflächenebene. Sie reagieren auf Benutzeranweisungen und geben die Ergebnisse zur Überprüfung durch den Benutzer zurück. In diesem Muster bleiben die zentrale Anwendungsarchitektur und die Workflow-Orchestrierung unverändert.

Mit zunehmender Akzeptanz von KI stehen technische Führungskräfte jedoch vor einer weitreichenderen Designentscheidung. Einige KI-Systeme dienen weiterhin als unterstützende Tools, während andere darauf ausgelegt sind, Aufgaben zu planen, mit internen Diensten zu interagieren und Entscheidungen über Workflows hinweg auszuführen. Der entscheidende Unterschied liegt eher in der architektonischen Verantwortung als im Funktionsumfang.

Für SaaS-Unternehmen, Scale-Up und regulierte Umgebungen wirkt sich diese Unterscheidung direkt auf das Systemdesign aus. Sie wirkt sich auf die Komplexität der Infrastruktur, die Beobachtbarkeitsanforderungen, das Compliance-Risiko und das Betriebsrisiko aus.

Dieser Leitfaden verdeutlicht den Unterschied zwischen generativer KI und agentischer KI — und erklärt, warum die Wahl zwischen beiden eine der wichtigsten technischen Entscheidungen ist, die Unternehmen in diesem Jahr treffen werden.

Definition der Paradigmen: Generierung vs. Ausführung

Um fundierte architektonische Entscheidungen treffen zu können, muss zunächst die Kernfunktionalität jedes Paradigmas isoliert werden.

Was ist Generative KI?

Generative KI bezieht sich auf probabilistische Modelle, meistens große Sprachmodelle, um Text, Code oder andere Artefakte als Reaktion auf Eingabeaufforderungen zu erzeugen. Das Interaktionsmuster ist reaktiv und anforderungsgesteuert: Ein Benutzer gibt eine Eingabe ein, und das System gibt eine Ausgabe zurück. Die Verantwortung für die Interpretation, Validierung und Umsetzung dieser Ausgabe liegt weiterhin außerhalb des Modells.

Der Markt für diese Content-Engines ist nach wie vor beträchtlich, mit Die Ausgaben der Endnutzer für GenAI-Modelle werden 2025 voraussichtlich 14,2 Milliarden US-Dollar erreichensowie 1,1 Milliarden US-Dollar für spezialisierte, domänenspezifische Modelle.

Zu den gängigen Unternehmensanwendungen gehören die Beschleunigung der Wissensarbeit, z. B. das Verfassen von Marketingtexten, das Zusammenfassen von Rechtsdokumenten oder die Codevervollständigung für Entwickler. Generative KI ist jedoch nicht für den Arbeitsablauf verantwortlich. Sie fungiert als Erweiterungsebene, auf der die endgültigen Aktionen und die Verantwortung beim menschlichen Benutzer verbleiben.

Was ist Agentic AI

Im Gegensatz dazu sind Agentic KI-Systeme darauf ausgelegt, Ziele zu verfolgen, anstatt isolierte Ergebnisse zu generieren. Diese Systeme können Aufgaben planen, einen Zwischenzustand aufrechterhalten, Tools oder APIs aufrufen und mehrstufige Workflows über Softwaregrenzen hinweg ausführen. Sie geben der Entscheidungsfindung Vorrang vor der Erstellung von Inhalten und benötigen keine kontinuierliche Überwachung, um in komplexen Umgebungen arbeiten zu können.

Statistische Prognosen deuten darauf hin, dass Agentic AI wird bis 2035 rund 30% des Umsatzes mit Unternehmensanwendungssoftware ausmachen, überstieg 450 Milliarden US-Dollar, gegenüber nur 2% im Jahr 2025.

Zu den Beispielen aus der Praxis gehören Die RecruitAI-Plattform von Codebridge, das die KI von Agentic in der Praxis veranschaulicht: ein Multi-Agenten-System, das Kandidaten autonom überprüft, Beurteilungen koordiniert, Interviews analysiert und Bewerber mithilfe integrierter Tools durch die Einstellungsabläufe führt. Anstatt isolierte Zusammenfassungen zu erstellen, planen und führen die Agenten mehrstufige Prozesse durch, wobei die endgültigen Entscheidungen unter menschlicher Aufsicht bleiben.

Neuausrichtung der Diskussion: Eine strategische Architekturentscheidung

Der Unterschied zwischen Gen AI und Agentic AI ist in erster Linie architektonischer Natur, nicht ein Vergleich der zugrunde liegenden Modelle. Das gleiche Grundmodell kann beiden Ansätzen zugrunde liegen, aber das umgebende Systemdesign bestimmt, ob KI isolierte Artefakte produziert oder die betriebliche Verantwortung innerhalb eines Workflows übernimmt. Für technische Führungskräfte wirkt sich die Wahl zwischen Erweiterung und Ausführung direkt auf das langfristige Systemdesign, die Kostenstruktur und die Anforderungen an die Unternehmensführung aus.

Vom Inhaltsfluss zum Kontrollfluss in Agentic Workflows

Die bedeutendste mentale Veränderung für Unternehmen ist der Übergang von Inhaltsfluss zu Kontrollfluss.

Generative KI stützt sich auf einen Inhaltsfluss, bei dem ein Benutzer eine Aufforderung gibt. Das Modell verarbeitet sie über eine zustandslose Inferenzpipeline und erzeugt ein statisches Artefakt, z. B. einen E-Mail-Entwurf, einen Codeausschnitt oder eine Textzusammenfassung. In diesem Fall bleibt das Modell inaktiv, bis es ausgelöst wird, und der menschliche Benutzer behält die Verantwortung für die Überprüfung und Implementierung der Ausgabe.

Agentic AI arbeitet nach dem Kontrollfluss. Anstatt eine einzelne Ausgabe zurückzugeben, koordiniert sie Daten und Aktionen über mehrere Systeme hinweg, um ein Ziel zu erreichen. In diesem Modell wandelt sich die Architektur von einem reaktiven Assistenten zu einem proaktiven digitalen Akteur, der seine Umgebung überwacht, Unteraufgaben identifiziert und Ausführungsschleifen durchläuft, bis ein Ziel erreicht ist oder ein sicherer Stopp erreicht ist.

Agentische KI-Architektur im Vergleich zu generativem Systemdesign

Zustandslose Inferenz-Pipelines kennzeichnen typischerweise die Architektur der Generativen KI. Die Integration erfolgt hauptsächlich auf der Schnittstellen- oder Datenebene, häufig unter Verwendung Augmentierte Generierung (RAG) um relevanten Dokumentenkontext in eine Aufforderung einzufügen, um Halluzinationen zu reduzieren. Dieser Ansatz ist zwar effektiv, um die Wissensarbeit zu beschleunigen, aber das Design ist grundsätzlich reaktiv und verfügt nicht über einen eigenständigen Arbeitsablauf.

Umgekehrt erfordert die KI-Architektur von Agentic ein mehrschichtiges Ausführungsdesign, das die Argumentation von Führungskräften nachahmt. Ein robustes System der Enterprise-Klasse umfasst in der Regel:

- Motoren für logisches Denken: Ein zentrales LLM (oder ein Ensemble von Modellen), das als kognitiver Motor fungiert, den Kontext interpretiert und übergeordnete Ziele in umsetzbare Pläne zerlegt.

- Ausführungsmodule: Ebenen, die über programmgesteuerte Funktionen mit externen Tools, APIs und Software interagieren, um Aufgaben wie das Aktualisieren eines CRM oder den Neustart eines Dienstes auszuführen.

- Orchestrierungs-Frameworks: Software, die die Komplexität von Systemen mit mehreren Agenten verwaltet und die Aufgabensequenzierung, Ressourcenzuweisung und Fehlerbehebung übernimmt.

Persistenter Speicher in KI-Agenten: Die Brücke zu zuverlässiger Autonomie

Generative KI-Systeme erfordern größtenteils, dass bei jeder Aufforderung ein relevanter Kontext bereitgestellt wird. Agentic-Systeme sind jedoch von Natur aus zustandsbehaftet. Um mehrstufige Ziele zuverlässig umsetzen zu können, müssen sie den Aufgabenkontext beibehalten, frühere Entscheidungen verfolgen und bei der Ausführung Feedback aus der Umgebung berücksichtigen.

Dies erfordert eine bewusste Speicherarchitektur. Kurzfristiges Gedächtnis fungiert als Arbeitskontext des Agenten und speichert Tool-Zwischenergebnisse, aktuelle Unterziele und den Ausführungsstatus innerhalb einer aktiven Sitzung. Im Langzeitgedächtnis werden dauerhafte Informationen wie Benutzerdaten, Unternehmensrichtlinien, historische Ergebnisse und Systemeinschränkungen gespeichert, auf die über mehrere Sitzungen hinweg zugegriffen werden muss.

Ohne strukturierte Speicherschichten wird Autonomie zu wiederholten Inferenzen, aber mit ihnen kann das System über die Zeit hinweg argumentieren und innerhalb definierter Grenzen operieren.

LLM-Infrastrukturkosten und die versteckte Ökonomie von KI-Systemen

Sobald die KI von der Generierung zur Ausführung übergeht, ändert sich die Kostenstruktur des Produkts. In generativen Systemen skaliert die Infrastruktur vorhersehbar, wobei jede Anfrage ein isolierter Inferenzaufruf ist und die Kosten linear mit der Nutzung korrelieren.

In agentischen Systemen wird Intelligenz jedoch Teil der Steuerungsebene, und die Preisgestaltung ändert sich von der Serververfügbarkeit zur kognitiven Anstrengung. Die Kosten eines Ergebnisses hängen nun davon ab, wie viele Denkschritte, Tool-Aufrufe und Reflexionszyklen erforderlich sind, um es zu erreichen.

Zustandslose API-Aufrufe im Vergleich zu zustandsbehafteten Systemen

Staatenhaftigkeit erhöht die architektonische Komplexität erheblich. Da Agentensysteme den Aufgabenverlauf und die Zwischenziele speichern, geht es bei der Skalierung um mehr als das Hinzufügen von Benutzerkapazität. Teams müssen eine große Anzahl gleichzeitiger Prozesse koordinieren, die über APIs, Datenbanken und Unternehmenssysteme hinweg ablaufen.

Diese Koordinationsebene führt ein, was viele Teams als Unzuverlässigkeitssteuer. Es handelt sich um zusätzliche Rechen-, Latenz-, Überwachungs- und technische Schutzmaßnahmen, die erforderlich sind, um probabilistische Ausfälle einzudämmen.

Ein Chatbot, der eine unvollständige E-Mail generiert, ist ein Problem mit der Benutzerfreundlichkeit. Ein autonomer Agent, der ein Ledger aktualisiert, wird zu einer betrieblichen Belastung.

LLM-Halluzinationen, Token-Wachstum und die Unzuverlässigkeitssteuer

Eines der am meisten unterschätzten wirtschaftlichen Risiken beim Agentendesign ist das quadratische Token-Wachstum. Mehrstufige Ausführungsschleifen senden den gesammelten Kontext oft bei jedem Schritt erneut, was bedeutet, dass ein Reflexionsprozess mit zehn Zyklen Dutzende Mal mehr Token verbrauchen kann als ein einziger Inferenzdurchgang.

Untersuchungen zeigen dass die Lösung eines komplexen Softwareproblems mit einem Agenten ohne Einschränkungen allein in Tokens zwischen 5 und 8 US-Dollar kosten kann. Im großen Maßstab erhöhen sich diese Kosten schnell.

Zuverlässigkeit bringt einen zweiten Kompromiss mit sich: Latenz. Die Single-Shot-LLM-Leistung bei komplexen Aufgaben erreicht häufig eine Genauigkeit von etwa 60 bis 70% Um die 95-prozentige Zuverlässigkeit zu erreichen, die für geschäftskritische Workflows erforderlich ist, sind in der Regel längere Argumentationsketten, Orchestrierungsebenen und eine iterative Validierung erforderlich.

Daher kann eine generative Reaktion zwar in weniger als einer Sekunde zurückkehren, es kann jedoch 10 bis 30 Sekunden dauern, bis eine Ausführungsschleife mit mehreren Agenten zu einem stabilen Ergebnis führt. Daher lautet die architektonische Frage für Technologieunternehmen nicht, ob Autonomie möglich ist, sondern welche Workflows den damit verbundenen Kosten- und Latenzaufwand rechtfertigen.

Dieser Kompromiss bedeutet nicht, dass Agentensysteme von Natur aus ineffizient sind. Es bedeutet, dass ihre Wirtschaftlichkeit bewusst gestaltet werden muss. Autonomie vergrößert die Rechenfläche, aber durchdachte architektonische Einschränkungen können Kosten, Latenz und Ausfallrisiken eindämmen. Die größte Herausforderung besteht darin, Systeme zu entwerfen, bei denen die Intelligenz proportional zum Geschäftswert skaliert.

Strategische Optimierungsmuster

Das Management der Gesamtbetriebskosten (TCO) erfordert mehr als die Wahl eines starken Modells. Es erfordert Kontrollen, die bestimmen, wann eine fundierte Argumentation tatsächlich erforderlich ist. Es haben sich mehrere Entwurfsmuster herauskristallisiert, um Autonomie mit wirtschaftlicher Disziplin in Einklang zu bringen.

- Routingmuster: Anstatt jede Anfrage an das leistungsfähigste (und teuerste) Modell zu senden, verwenden Sie einen leichten Klassifikator, um einfache Aufgaben mit günstigen, schnellen Modellen zu erledigen und nur komplexe Überlegungen an leistungsfähigere Agenten weiterzuleiten.

- Prompt-Caching: Wenn ein Agent ständig auf dieselbe umfangreiche Wissensdatenbank oder denselben Satz von Anweisungen verweist, verwenden Sie das Prompt-Caching, um eine erneute Verarbeitung dieses Textes zu vermeiden. Dadurch können die Inputkosten um ungefähr reduziert werden 90% und Latenz von bis zu 75%.

- Dynamische Wendebegrenzungen: Anstatt eine feste Obergrenze für Agenten-Iterationen zu verwenden, sollten Sie Grenzwerte implementieren, die auf der Erfolgswahrscheinlichkeit basieren. Zu erkennen, wann ein Agent eine Aufgabe wahrscheinlich nicht lösen wird, und den Kreis vorzeitig zu verlassen, kann Senken Sie die Token-Kosten um bis zu 24% ohne die Gesamtlösungsraten zu beeinflussen.

- Speicherschichten: Implementieren Sie eine dedizierte Speicherebene, um erfolgreiche Pläne und vergangene Interaktionen zu speichern. Wenn diese Ebene zuerst abgefragt wird, kann sich ein Agent an ein zuvor gelöstes Problem erinnern und die Lösung innerhalb von Millisekunden abrufen, anstatt die Planung mit hohen Kosten von Grund auf neu zu planen.

Unternehmensführung, Risiko und Compliance in regulierten Bereichen

Wenn ein KI-System handlungsfähig wird, erweitert sich die Sicherheitsfläche des Unternehmens. Ein generatives System kann falschen Text erzeugen, aber ein agentisches System kann Datensätze ändern, Transaktionen auslösen oder Fehler auf integrierten Plattformen weitergeben. Autonomie erhöht den Umfang und die potenziellen Auswirkungen von Ausfällen oder Missbrauch.

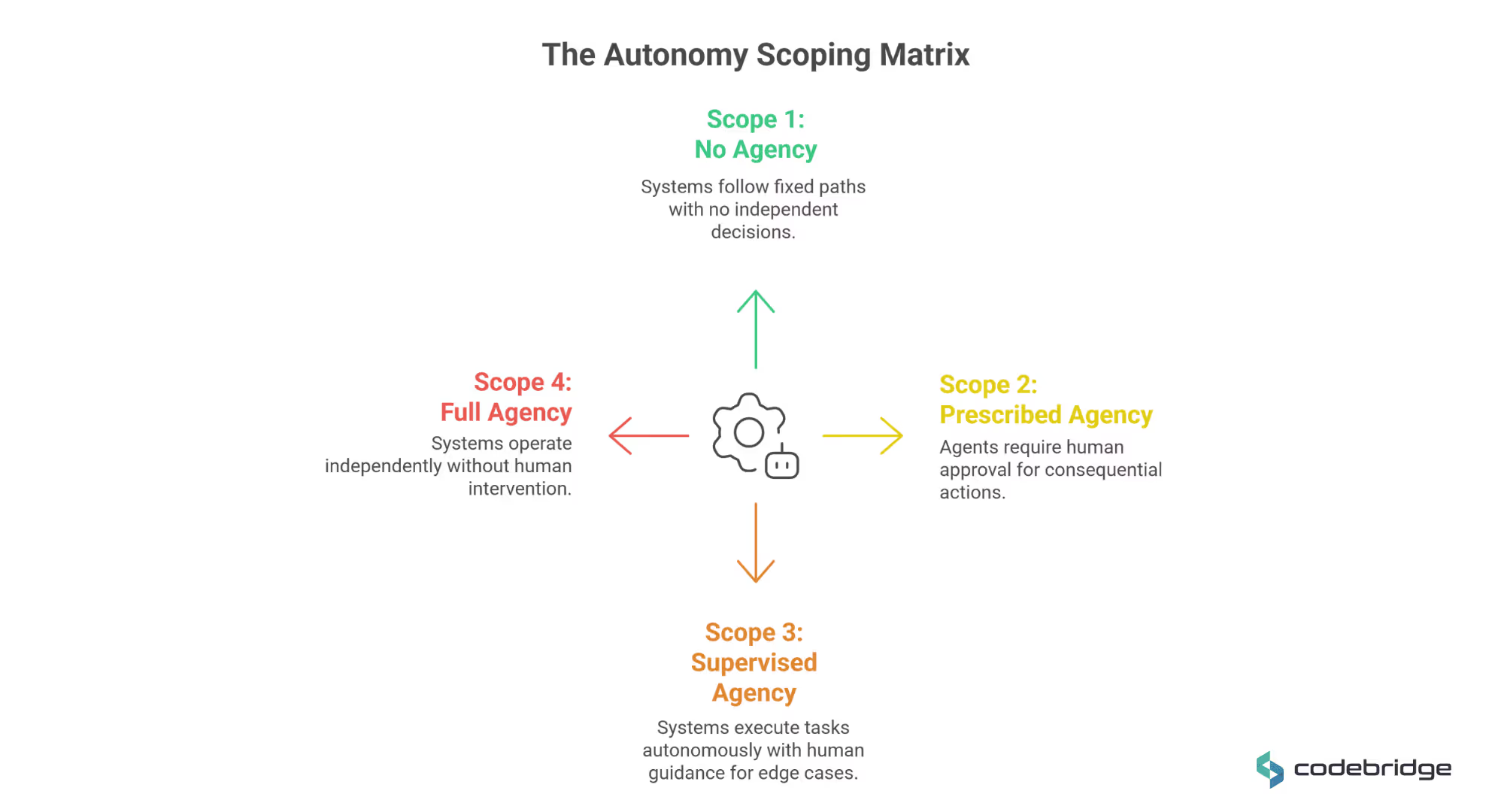

Stufen der KI-Autonomie: Die Autonomy Scoping Matrix

Um diese Risiken zu bewältigen, müssen technische Führungskräfte ihre Architektur mithilfe einer strukturierten Scoping-Matrix an der spezifischen Risikotoleranz des Unternehmens ausrichten. Dieses Framework kategorisiert agentische Architekturen auf der Grundlage ihres Konnektivitätsniveaus und ihrer unabhängigen Entscheidungsfindung:

- Geltungsbereich 1: Keine Agentur. Diese Systeme sind im Wesentlichen schreibgeschützt und folgen von Menschen initiierten, festen Ausführungspfaden. Die Sicherheit konzentriert sich auf die Prozessintegrität und die Durchsetzung von Grenzen.

- Geltungsbereich 2: Vorgeschriebene Behörde. Agenten können den Systemstatus ändern, benötigen jedoch für jede Folgeaktion eine strikte HITL-Genehmigung (Human-in-the-Loop). Dieser Umfang ist in regulierten Umgebungen üblich, in denen eine manuelle Überprüfung gesetzlich erforderlich ist.

- Umfang 3: Beaufsichtigte Agentur. Systeme führen komplexe Aufgaben nach einem menschlichen Auslöser autonom aus. Sie nutzen eine dynamische Werkzeugauswahl und benötigen nur menschliche Führung für Grenzfälle oder die Optimierung der Bewegungsbahn.

- Geltungsbereich 4: Volle Agentur. Dies sind selbstinitiierende Systeme, die Workflows mehrerer Systeme ohne menschliches Eingreifen orchestrieren. Sie erfordern eine fortschrittliche Anomalieerkennung und automatische Eindämmungsmechanismen, um außer Kontrolle geratene Prozesse zu verhindern.

EU-KI-Gesetz, HIPAA und GDPR: KI-Compliance-Realitäten für CTOs

In regulierten Sektoren wie dem Gesundheitswesen und dem Finanzwesen wird die Grenze zwischen assistiver KI und autonomer Ausführung auf Systemebene zu einer Compliance-Anforderung. Der Gerätezugriff und der Datenfluss müssen nach Grundsätzen wie dem Grundsatz der geringsten Rechte geregelt werden, insbesondere im Rahmen von Regelungen wie HIPAA, GDPR und dem EU-KI-Gesetz. Diese Rahmenbedingungen erfordern Rückverfolgbarkeit, Datenverwaltungskontrollen und die Erklärbarkeit automatisierter Entscheidungen, da ein autonomes System ohne überprüfbare Abstammung nicht nur riskant, sondern auch nicht konform ist.

Im Gesundheitswesen ist für die Verarbeitung von PHI ein Business Associate Agreement (BAA) mit Cloud-Anbietern erforderlich — auch wenn die Daten verschlüsselt oder nicht direkt einsehbar sind. Ein BAA stellt sicher, dass die gesamte Verarbeitungskette den Sicherheitsstandards des Bundes entspricht. Mithilfe von Tools wie der Websuche innerhalb eines Agenten kann die HIPAA-Zulassung ungültig werden, wenn diese spezifischen Endpunkte nicht von der Vereinbarung abgedeckt sind.

Gemäß dem EU-Gesetz über künstliche Intelligenz müssen Agentensysteme auf eine strenge Steuerung, Risikoberichterstattung und Überwachung von Vorurteilen vorbereitet sein, insbesondere wenn sie Szenarien mit hohem Risiko betreffen. Autonomes Handeln ohne eine klare, überprüfbare Argumentationskette ist in diesen Ländern inakzeptabel.

Beobachtbarkeit und Überwachung als obligatorische Ebene

Daher wird Beobachtbarkeit grundlegend. Herkömmliches Application Performance Monitoring (APM) reicht nicht für nichtdeterministische Systeme aus, die zwar technisch einwandfrei erscheinen, aber zu fehlerhaften Argumenten führen.

Entwicklungsteams müssen Trace-First-Überwachungspraktiken wie OpenTelemetrie-Instrumentierung anwenden, um Ausführungspfade, Entscheidungspunkte und Werkzeuginteraktionen zu erfassen. Ohne strukturierte Spuren ist es extrem schwierig zu rekonstruieren, warum ein Agent so gehandelt hat, wie er gehandelt hat.

Entscheidungsrahmen: Wann sollte welcher verwendet werden?

Die Wahl zwischen einer generativen KI-Schnittstelle und einem vollständigen Agentic KI-System wird zu einer strategischen Entscheidung, da die Wahl bestimmt, wie viel Verantwortung das System übernimmt — und das wirkt sich auf Architektur, Kosten, Risiko und Governance aus. Führungskräfte sollten ihren Ansatz auf das Maß an Workflow-Kontrolle, Zuverlässigkeit und Risiko ausrichten, das sie bereit sind einzugehen.

Wann sollte Generative KI eingesetzt werden

Generative KI ist optimal, wenn das Ziel die Informationssynthese und die Unterstützung menschlicher Entscheidungen ist, anstatt Systeme zu aktualisieren, APIs aufzurufen oder operative Aufgaben auszuführen.

- Primäres Ziel: Inhaltserstellung, schnelles Prototyping oder Entscheidungsunterstützung durch menschliche Anwender. Die KI der Generation eignet sich hervorragend zur Beschleunigung der Wissensarbeit, z. B. beim Verfassen von E-Mail-Newslettern, der Zusammenfassung wissenschaftlicher Arbeiten oder der Unterstützung von Entwicklern bei der Codevervollständigung.

- Risikoprofil: Wenn das Unternehmen eine niedrige Risikotoleranz hat, muss das menschliche Urteilsvermögen die letzte Instanz bleiben. Wenn ein Fehler nur zu unangenehmem Text und nicht zu einer unbefugten Zustandsänderung führt, reichen die KI-Muster der Generation in der Regel aus.

- Zeit bis zur Amortisierung: Wenn der Fokus darauf liegt, schnelle Produktivitätssteigerungen durch individuelle Augmentation zu erzielen. Der Einsatz eines Copiloten ist schneller und technisch weniger anspruchsvoll als der Aufbau eines autonomen digitalen Aktors.

Wann sollte Agentic AI entwickelt werden?

Agentische KI wird notwendig, wenn ein System eigenständig mehrstufige Aufgaben ausführen muss, wie z. B. das Aktualisieren von Datensätzen, das Auslösen von Transaktionen oder das Koordinieren von Aktionen über mehrere Tools hinweg, ohne bei jedem Schritt auf die Zustimmung eines Menschen warten zu müssen.

- Primäres Ziel: Komplexe, mehrstufige Ausführung über integrierte Unternehmenstools wie ERP-, CRM- oder Ticketsysteme. Agentic AI ist so konzipiert, dass sie die Arbeit erledigt, indem sie mehrere Plattformen koordiniert, um ein messbares Geschäftsergebnis zu erzielen.

- Operativer Umfang: Wenn Geschwindigkeit, Verfügbarkeit rund um die Uhr und autonome Skalierung Vorrang vor kreativen Nuancen haben. Agentic Systeme eignen sich ideal für sich wiederholende, regelgebundene Prozesse, bei denen menschliche Engpässe das Wachstum derzeit einschränken.

- Anpassungsfähigkeit: Wenn das System dynamisch auf sich ändernde Umgebungsbedingungen oder unstrukturierte Daten reagieren muss, die ein festes RPA-Skript nicht verarbeiten kann.

Von Copiloten zu autonomen KI-Agenten: Ein progressives Autonomiemodell

Für eine langfristige Lieferung empfehlen wir ein schrittweises Adoptionsmodell. Das Framework ermöglicht es einem Unternehmen, durch zunehmende Komplexität eine ausgereifte Architektur aufzubauen und Vertrauen in autonome Systeme zu gewinnen.

- Phase 1: Augmentation (Generative KI-Copiloten): Setzen Sie reaktive Assistenten ein, um menschlichen Mitarbeitern bei der Analyse von Daten und der Erstellung von Inhalten zu helfen. In dieser Phase behalten die Menschen die Entscheidungsbefugnis und die Ausführungsverantwortung zu 100%.

- Phase 2: Unterstützte Automatisierung (Human-in-the-Loop-Agenten): Stellen Sie Agenten vor, die Maßnahmen planen und vorbereiten können, aber vor der Durchführung einer Statusänderung eine ausdrückliche menschliche Genehmigung (Approval Gates) benötigen. Diese beaufsichtigte Behörde begrenzt den Explosionsradius potenzieller Fehler und automatisiert gleichzeitig die Schritte zur Datenerfassung und Argumentation.

- Phase 3: Eingeschränkte Autonomie (vollständig agentische Workflows): Skalieren Sie auf Systeme, die systemübergreifende Workflows unabhängig voneinander innerhalb genau definierter Richtlinien-, Kosten- und Risikobeschränkungen initiieren und ausführen. Diese Systeme funktionieren wie eine digitale Belegschaft und erfordern ein Höchstmaß an Beobachtbarkeit und Steuerung, um die Übereinstimmung mit den Unternehmenszielen sicherzustellen.

Fazit

Der Unterschied zwischen Gen AI und Agentic AI macht den Unterschied zwischen einer Anwendung, die Benutzer unterstützt, und einer Infrastruktur, die das Unternehmen betreibt. Generative KI hat zwar das Potenzial für Konversationsintelligenz ausgeschöpft, aber Autonomie erfordert eine vollständige architektonische Transformation — eine, bei der Zustandspersistenz, Orchestrierungs-Engines und Ausführungsbefugnisse im Mittelpunkt stehen.

Für Scale-Ups ist die Behandlung von Agentic AI als einfache API-Integration ein Rezept für kaskadierende Fehler, unüberschaubare Token-Kosten und Compliance-Fehler. Um im Zeitalter der Agententik erfolgreich zu sein, ist eine durchdachte Architekturplanung im Hinblick auf Speicherebenen, Tool-Orchestrierung, Compliance und strenge Beobachtbarkeit erforderlich.

Viele Unternehmen beginnen mit dem Übergang zu einer KI-nativen Infrastruktur, und technische Führungskräfte, die heute in autonome, gesteuerte und skalierbare Agentenarchitekturen investieren, werden die selbstoptimierenden Organisationen von morgen aufbauen.

Heading 1

Heading 2

Heading 3

Heading 4

Heading 5

Heading 6

Lorem ipsum dolor sit amet, consectetur adipiscing elit, sed do eiusmod tempor incididunt ut labore et dolore magna aliqua. Ut enim ad minim veniam, quis nostrud exercitation ullamco laboris nisi ut aliquip ex ea commodo consequat. Duis aute irure dolor in reprehenderit in voluptate velit esse cillum dolore eu fugiat nulla pariatur.

Block quote

Ordered list

- Item 1

- Item 2

- Item 3

Unordered list

- Item A

- Item B

- Item C

Bold text

Emphasis

Superscript

Subscript

.avif)

.avif)