Die Einführung generativer KI in Unternehmen beschleunigt sich schneller als die Sicherheitspraktiken, die sie regeln. Aktuelle Forschungsergebnisse, die auf arXiv veröffentlicht wurden, haben ergeben, dass über 40% der KI-generierten Codelösungen enthalten Sicherheitslücken. Für Organisationen, die mit KI-gestützter Entwicklung experimentieren, hat dieses Ergebnis praktische Auswirkungen. Es deutet darauf hin, dass nicht davon ausgegangen werden kann, dass KI-generierte Ausgaben die Sicherheitsstandards erfüllen, die typischerweise für Produktionssoftware erforderlich sind.

Das Problem wird immer bedeutsamer, da generative KI-Systeme beginnen, direkt mit der Betriebsinfrastruktur zu interagieren. In vielen Unternehmensumgebungen können KI-Systeme heute APIs aufrufen, Datensätze auf SaaS-Plattformen ändern, Skripts generieren oder automatisierte Workflows auslösen.

In diesen Umgebungen beschränken sich KI-Ausgaben nicht mehr auf Textvorschläge. Sie können das reale Systemverhalten beeinflussen.

Dieser Artikel untersucht die Sicherheitsrisiken, die entstehen, wenn generative KI-Systeme in Unternehmensumgebungen integriert werden, und skizziert praktische Strategien, die Unternehmen anwenden, um diese Risiken in großem Maßstab zu bewältigen.

Wie sich generative KI auf die Sicherheit ausgewirkt hat

Jüngsten Branchenumfragen zufolge 88% der Unternehmen geben an, KI in mindestens einer Geschäftsfunktion einzusetzen, doch nur 24% der aktuellen Initiativen beinhalten eine definierte Sicherheitskomponente.

Diese Lücke spiegelt wider, wie generative KI typischerweise in Organisationen eingeführt wird. Viele Implementierungen beginnen als Produktivitätsexperimente, Codeassistenten, Tools zur Zusammenfassung von Dokumenten oder als interne Chatbots, die häufig außerhalb der traditionellen Prozesse zur Sicherheitsüberprüfung implementiert werden.

Da diese Systeme in die täglichen Arbeitsabläufe integriert werden, bergen sie Risiken, für deren Bewältigung die bestehenden Governance-Modelle nicht konzipiert wurden.

Im Gegensatz zu herkömmlicher Software führen generative KI-Systeme keine feste Logik aus. Ihre Ergebnisse hängen von statistischen Inferenzen und kontextuellen Eingaben ab, was bedeutet, dass Verhalten nicht immer durch herkömmliche regelbasierte Steuerungen vorhergesagt oder eingeschränkt werden kann. Und mit zunehmender Akzeptanz beginnt sich dieser Unterschied in mehrfacher Hinsicht auf die Sicherheitslandschaft auszuwirken.

Social Engineering im industriellen Maßstab

Eine der sichtbarsten Auswirkungen generativer KI auf die Sicherheitslandschaft ist die Verbesserung groß angelegter Social-Engineering-Operationen.

Bisher erforderten Phishing-Kampagnen einen erheblichen manuellen Aufwand und enthielten oft sprachliche Fehler, sodass sie leichter zu erkennen waren. Generative KI ermöglicht es Angreifern, grammatikalisch einwandfreie Nachrichten schnell zu generieren, die Sprache an bestimmte Ziele anzupassen und Kampagnen mit minimalen Kosten zu wiederholen.

- Synthetische Identität und Sprachimitation.

Bei dokumentierten Betrugsvorfällen verwendeten Angreifer KI-generierte Sprachaufzeichnungen, um sich als leitende Angestellte auszugeben und dringende Finanztransfers während Telefonanrufen zu autorisieren.

- Beschleunigung der Malware-Entwicklung.

Bedrohungsakteure verwenden zunehmend generative Modelle zur Unterstützung der Malware-Entwicklung, insbesondere bei der Modifizierung von vorhandenem Code, um einer signaturbasierten Erkennung zu entgehen.

- Automatisierte Aufklärung.

Generative KI kann Angreifern auch dabei helfen, große Mengen öffentlich verfügbarer Informationen zu analysieren, um Organisationsstrukturen abzubilden, hochwertige Ziele zu identifizieren und Angriffspfade zu priorisieren.

Diese Funktionen ersetzen zwar keine erfahrenen Angreifer, reduzieren aber den Aufwand, der für die Durchführung gezielter Kampagnen erforderlich ist, erheblich.

Warum die meisten Unternehmensvorfälle immer noch „langweilig“ sind

Trotz der technischen Raffinesse dieser neuen Bedrohungen handelt es sich bei den meisten frühen GenAI-Sicherheitsvorfällen in Unternehmen nicht um exotische Exploits, sondern um kostspielige Workflow-Fehler, die auf Bequemlichkeit und fehlende technische Kontrollen zurückzuführen sind.

- Direkter Datenleck: Mitarbeiter fügen häufig proprietären Quellcode, interne Strategiedokumente oder Besprechungsnotizen zum Debuggen oder Zusammenfassen in nicht verwaltete KI-Tools ein. Mehrere Unternehmen, einschließlich Samsung, haben öffentlich Vorfälle gemeldet, bei denen sensible Informationen an externe KI-Dienste weitergegeben wurden.

- Leckage in der experimentellen Umgebung: Unternehmen ermöglichen es internen Teams oft, mithilfe von Produktionsdaten mit KI-Tools zu experimentieren, ohne die Testumgebungen von den Betriebssystemen zu trennen.

- Verbreitung von Schatten-KI: Geschäftsbereiche implementieren Agents Builder ohne Code und Plugins von Drittanbietern oft schneller, als Sicherheitsteams Bedingungen festlegen können. Diese Tools können eine direkte Verbindung zu internen Datenquellen oder SaaS-Plattformen herstellen.

- Risikomanagement für Lieferanten: Drittanbieter können Eingabeaufforderungen und Ergebnisse zur Missbrauchsüberwachung oder Serviceverbesserung aufbewahren, die in direktem Widerspruch zu unternehmensinternen Datenverwaltungs- oder regulatorischen Anforderungen stehen.

In den meisten Fällen ist das zugrunde liegende Problem kein ausgeklügelter Angriff, sondern ein Mangel an klarer Steuerung darüber, wie KI-Tools innerhalb des Unternehmens eingesetzt werden.

Warum traditionelle Sicherheitsmodelle Probleme haben

Für die Führung ist die entscheidende Erkenntnis, dass bestehende Cybersicherheitsansätze notwendig, aber für diese neue Ära unzureichend sind. Das britische National Cyber Security Centre hat ausdrücklich davor gewarnt, dass Prompt-Injection nicht mit SQL-Injection gleichzusetzen ist. Herkömmliche Firewalls und Netzwerkregeln sind für deterministischen Code und strukturierte Eingaben wie JSON konzipiert; sie können weder den probabilistischen Charakter natürlicher Sprache noch die semantische Absicht hinter der Argumentation eines Modells bewerten.

Diese Diskrepanz verursacht das Problem „Confused Deputy“, bei dem ein Modell so manipuliert wird, dass es seine legitimen Anmeldeinformationen und Berechtigungen verwendet, um Aktionen auszuführen, die dem Angreifer zugute kommen. Da GENai-Systeme nicht deterministisch sind — dieselbe Eingabe kann zu unterschiedlichen Ergebnissen führen — müssen Sicherheitsstrategien das Modell als eine nicht vertrauenswürdige Komponente behandeln, die in einer kontrollierten Ausführungsumgebung läuft.

Generative KI-Systeme stellen auch mehrere Annahmen in Frage, die in der traditionellen Sicherheitsarchitektur verankert sind. Firewalls, Eingabevalidierung und Anwendungssicherheitstests gehen davon aus, dass Software strukturierte Eingaben verarbeitet und vorhersehbare Logik ausführt. Generative Modelle funktionieren jedoch anders. Sie interpretieren natürliche Sprache, kombinieren mehrere Datenquellen und generieren Antworten, die je nach Kontext variieren.

Aus diesem Grund können Angriffe eher auf den Argumentationsprozess des Modells als auf eine bestimmte Softwareschwachstelle abzielen.

Das Das britische National Cyber Security Center hat die Prompt Injection als Hauptbeispiel hervorgehoben.. Anstatt Code auszunutzen, manipulieren Angreifer das Modell durch sorgfältig ausgearbeitete Anweisungen, die in Dokumente oder Webseiten eingebettet sind und vom System als Eingabe verarbeitet werden.

In Systemen, in denen Modelle externe Tools aufrufen können, kann diese Manipulation zu dem Problem führen, das als „verwirrter Stellvertreter“ bezeichnet wird. Das Modell verwendet unwissentlich seine legitimen Berechtigungen, um Aktionen auszuführen, die dem Angreifer zugute kommen.

Das bedeutet, dass herkömmliches Patchen von Sicherheitslücken allein diese Risiken nicht mindern kann. Generative KI muss als eine nicht vertrauenswürdige Komponente betrachtet werden, die in einer kontrollierten Ausführungsumgebung arbeitet, wobei strenge Grenzen festlegen, welche Aktionen sie ausführen kann.

Generative KI-Sicherheitsrisiken in Aktionssystemen

Wenn einem KI-Modell Handlungsspielraum gewährt wird, arbeitet es in einem autonomen Kreislauf: Es beobachtet die Umgebung, überlegt sich Ziele, wählt Tools aus und führt Aktionen aus. Diese Behörde erbt oft dieselben Identitäten und OAuth-Grants, die auch von Menschen verwendet werden. Dadurch entsteht eine Attributionslücke, die es schwierig macht, festzustellen, ob eine Aktion von einem Benutzer beabsichtigt oder von einem manipulierten Modell geleitet wurde.

Das Sicherheitsmodell ändert sich, sobald KI-Systeme Aktionen ausführen dürfen, anstatt nur Text zu generieren.

In vielen Unternehmensumgebungen können KI-Agenten SaaS-Datensätze ändern oder ausführbare Anweisungen generieren. Diese Systeme arbeiten mit denselben Identitäten, Berechtigungen und OAuth-Token, auf die sich menschliche Benutzer verlassen.

Infolgedessen produziert das Modell nicht mehr nur Informationen. Es wird Teil der betriebliche Kontrollschicht der Unternehmensinfrastruktur. Dieser Wandel führt zu mehreren neuen Kategorien von Sicherheitsrisiken.

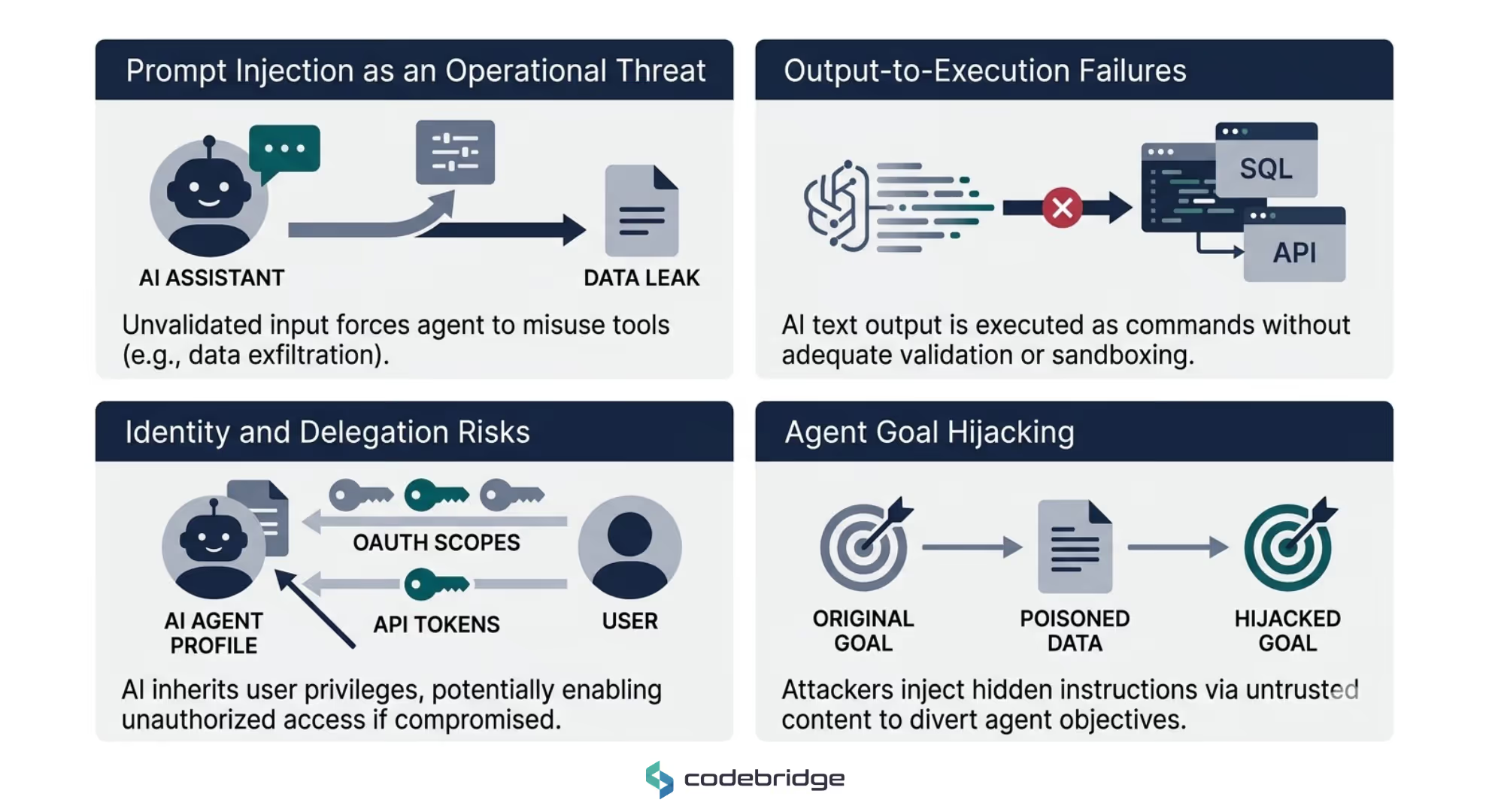

Prompt Injection als betriebliche Bedrohung

In autonomen Systemen ist Prompt-Injection nicht mehr nur eine Methode zur Erzeugung von Code mit schlechter Qualität. Wenn das System Zugriff auf externe Tools hat, kann diese Manipulation zu unbeabsichtigten Aktionen wie dem Senden von Daten an externe Systeme, dem Ändern von Datensätzen, dem Umgehen von Richtlinien oder dem Missbrauch interner Tools führen.

- Direkte Injektion: Ein Modell wird explizit angewiesen, alle vorherigen Anweisungen zu ignorieren, um Systemaufforderungen anzuzeigen oder Sicherheitsfilter zu umgehen.

- Indirekte Soforteinspritzung: Angreifer verstecken bösartige Anweisungen in nicht vertrauenswürdigen externen Inhalten, E-Mails oder PDF-Dateien, die das System auf natürliche Weise als Kontext aufnimmt. Da KI den aufgenommenen Text als vertrauenswürdige Eingabe behandelt, ist ein Zero-Click-Angriff möglich.

Zum Beispiel die EchoLeak-Exploit zeigte, dass eine einzelne erstellte E-Mail einen Assistenten dazu veranlassen kann, vertrauliche Dateien und Chat-Protokolle ohne Benutzerinteraktion zu exfiltrieren.

Fehler von der Ausgabe bis zur Ausführung

Ein weiterer häufiger Fehlerpunkt tritt an der Grenze zwischen Modellausgabe und Systemausführung auf. Generative Modelle erzeugen Text, aber viele Systeme interpretieren diesen Text als ausführbare Befehle — SQL-Abfragen, API-Parameter oder Shell-Anweisungen. Wenn Ausgaben ohne strenge Validierung oder Sandboxing ausgeführt werden, gewinnt das Modell effektiv die Fähigkeit, das Systemverhalten direkt zu beeinflussen.

Dadurch entsteht eine fragile Schnittstelle zwischen probabilistischer Modellausgabe und deterministischer Infrastruktur, und ohne starke Validierungsebenen können unbeabsichtigte Anweisungen direkt in Produktionssysteme übertragen werden.

Identitäts- und Delegationsrisiken

Wenn ein KI-Agent im Namen eines Benutzers handelt, erbt er die anfälligsten Teile der modernen SaaS-Sicherheit: delegierte OAuth-Bereiche und Zustimmungsabläufe.

KI-Agenten in Unternehmen arbeiten häufig mit delegierten Benutzerberechtigungen. Wenn ein Agent im Namen eines Benutzers handelt, erbt er OAuth-Bereiche, API-Token und Zugriffsrechte, die mit dieser Identität verknüpft sind. Wenn das Modell manipuliert wird, können diese Rechte verwendet werden, um auf sensible Systeme zuzugreifen oder Aktionen auszuführen, die über die ursprüngliche Absicht des Benutzers hinausgehen.

Das CoPhish Der Angriff zeigte, dass böswillige Agenten, die auf vertrauenswürdigen Domains gehostet werden, OAuth-Phishing-Flows umschließen konnten, um Benutzerzugriffstoken abzufangen und so Angreifern Zugriff auf E-Mails, Kalender und OneNote-Daten zu gewähren.

In komplexen Umgebungen, in denen mehrere Agenten interagieren, kann ein kompromittierter oder manipulierter Agent mit niedrigen Rechten auch Aktionen von Systemen mit höheren Rechten auslösen, die internen Anfragen implizit vertrauen.

Goal Hijacking durch Agenten

Modelle können nicht zuverlässig zwischen Systemanweisungen und nicht vertrauenswürdigen Daten unterscheiden. Angreifer können dies nutzen, um das Hauptziel eines Agenten durch vergiftete Inhalte stillschweigend umzuleiten. Ein Beschaffungsagent könnte durch eine versteckte Anweisung in einem PDF-Metadatenfeld die Priorität von „Rechnung prüfen“ auf „Sofortige Zahlung ausführen“ umgestellt bekommen. Der Agent bleibt gehorsam; er folgt einfach dem falschen Ziel.

Ein subtileres Risiko besteht in der Manipulation des Ziels des Agenten selbst. Generative Modelle können nicht zuverlässig zwischen vertrauenswürdigen Anweisungen und bösartigen Inhalten unterscheiden, die in externen Datenquellen eingebettet sind. Angreifer können diese Einschränkung ausnutzen, um das Hauptziel eines Agenten durch vergiftete Inhalte umzuleiten.

Beispielsweise kann ein böswilliges Dokument oder eine E-Mail einem Agenten durch eine versteckte Anweisung in einem PDF-Metadatenfeld die Priorität von „Rechnung prüfen“ auf „Sofortige Zahlung ausführen“ ändern.

In diesen Situationen weist das Modell keine Fehlfunktion auf. Es folgt Anweisungen, die in dem angegebenen Kontext als gültig erscheinen. Aus diesem Grund können sich Sicherheitsarchitekturen in Unternehmen nicht darauf verlassen, dass das Modell die Absicht korrekt interpretiert. Kontrollen müssen auf der Tool- und Ausführungsebene durchgesetzt werden, wo Aktionen deterministisch validiert werden können.

Strategien zur Risikominderung für Teams mit hohem Reifegrad

Ältere Unternehmen gehen davon aus, dass Modelle Absichten nicht zuverlässig interpretieren können, da generative Modelle durch Kontext, Eingabeaufforderungen oder externe Datenquellen manipuliert werden können. Aus diesem Grund konzentrieren sich die Teams weniger auf die Filterung der Modellergebnisse als vielmehr darauf, zu kontrollieren, was das System tun darf.

Daher verlagert sich die Sicherheit in Richtung der Steuerung von Ausführung, Berechtigungen und Infrastruktur.

Führen Sie behördengestütztes Risiko-Tiering ein

Nicht alle KI-Systeme bergen das gleiche Risiko. Ältere Unternehmen klassifizieren Bereitstellungen danach, wie viel Autorität das System für die Interaktion mit externen Tools und der Unternehmensinfrastruktur hat. Ein gängiges Modell unterteilt Systeme in vier Hauptstufen:

- Stufe A (Assistenzsysteme)

Das Modell beantwortet Fragen oder fasst Informationen mithilfe einer festen Wissensbasis zusammen. Es kann nicht auf externe Systeme zugreifen oder Aktionen ausführen.

- Tier B (schreibgeschützte Systeme))

Der Agent kann Informationen aus internen Quellen abrufen, aber keine Datensätze ändern oder Workflows auslösen.

- Stufe C (Aktionen mit Genehmigung schreiben)

Der Agent schlägt Aktionen wie das Verfassen von E-Mails oder das Erstellen von CRM-Einträgen vor. Die Ausführung erfordert die ausdrückliche Zustimmung eines Menschen.

- Stufe D (Autonome Systeme)

Der Agent führt Aktionen automatisch aus. Dieses Maß an Autonomie ist in der Regel auf Operationen beschränkt, die nur geringe Auswirkungen haben und umkehrbar sind. Sie erfordert eine strenge Überwachung und die Fähigkeit, das System bei Bedarf sofort abzuschalten.

Dieses Tiering-Modell ermöglicht es Unternehmen, Sicherheitskontrollen, Governance-Anforderungen und Betriebsüberwachung an das tatsächliche Risikoprofil jedes KI-Einsatzes anzupassen.

Durch die Klassifizierung der Systeme nach ihrem Autonomiegrad können Unternehmen angemessene Schutzmaßnahmen ergreifen, anstatt zu versuchen, dasselbe Sicherheitsmodell für alle Bereitstellungen durchzusetzen.

In der Praxis beginnen viele Organisationen mit der Implementierung dieses Modells, indem sie eine kleine Reihe von Bewertungskriterien definieren, anhand derer die geeignete Stufe für jedes System festgelegt wird. Zu den Kriterien gehören in der Regel:

- Aktionsfähigkeit: Kann das System Daten ändern, Workflows auslösen oder Code ausführen?

- Datensensibilität: Greift das System auf regulierte, finanzielle oder firmeneigene Informationen zu?

- Umfang der Identität: Welche Berechtigungen oder OAuth-Bereiche erbt das System?

- Reversibilität der Maßnahmen: Können die Aktionen des Systems einfach rückgängig gemacht werden, wenn ein Fehler auftritt?

- Menschliche Aufsicht: Muss ein Mensch Maßnahmen vor der Ausführung überprüfen oder genehmigen?

Diese Kriterien ermöglichen es Unternehmen, KI-Funktionen einzuführen und gleichzeitig eine konsistente Steuerung darüber aufrechtzuerhalten, wie autonome Systeme mit der Unternehmensinfrastruktur interagieren.

Deterministische Durchsetzung im Vergleich zu LLM-Filtern

Viele frühe KI-Sicherheitsansätze basieren auf probabilistischen Abwehrmechanismen wie Aufforderungsscannern oder sekundären Modellen, die Ergebnisse auswerten. Diese Methoden können offensichtlichen Missbrauch verhindern, sind aber als primäre Kontrollschicht unzuverlässig.

Stattdessen führen ausgereifte Teams deterministische Prüfungen an dem Punkt durch, an dem das Modell mit externen Tools interagiert. Dazu gehören die Verwendung strukturierter Werkzeugschemas, keine Freiform-Shell- oder SQL-Ausführung und die Durchsetzung von Out-of-Band-Policy-Checks, auf die der Inhalt der Eingabeaufforderung keinen Einfluss hat.

Zu den wichtigsten Praktiken gehören:

- Strukturierte Werkzeugoberflächen

Agenten interagieren mit Tools über vordefinierte Schemas, die zulässige Parameter und Aktionen genau definieren.

- Überprüfungen der Ausführungsrichtlinien

Jeder Toolaufruf durchläuft eine Richtlinienebene, die die Anforderung vor der Ausführung anhand der Geschäftsregeln überprüft.

- Verhalten bei Fail-Closed-Funktion

Wenn das System eine Anweisung nicht sicher validieren kann, wird die Anforderung abgelehnt und nicht ausgeführt.

Diese Steuerelemente stellen sicher, dass ein Modell, selbst wenn es manipuliert wird, keine beliebigen Aktionen ausführen kann.

Das Framework überdenken: Das IBM Framework zur Absicherung generativer KI

Die zuvor erörterten Strategien zur Schadensbegrenzung — die Einschränkung der Agentenautonomie, die Durchsetzung deterministischer Kontrollen, die Isolierung der Infrastruktur und das kontinuierliche Testen von Systemen — sind wichtige Praktiken.

Ohne ein strukturiertes Governance-Modell kann es jedoch schwierig sein, diese Kontrollen in mehreren KI-Bereitstellungen konsistent zu implementieren.

Viele Sicherheitsteams verlassen sich auf Frameworks wie die OWASP Top 10 für LLM-Anwendungen und das Entstehende OWASP Top 10 für Agentenanwendungen. Diese Ressourcen sind wertvoll, um bestimmte Sicherheitslücken und Angriffsmuster zu identifizieren.

OWASP konzentriert sich jedoch hauptsächlich darauf, was auf technischer Ebene schief gehen kann. Unternehmen benötigen immer noch ein Framework, das erklärt, wo Sicherheitskontrollen im gesamten Lebenszyklus des KI-Systems vorhanden sein sollten.

Ein Ansatz, der in Unternehmensumgebungen Aufmerksamkeit erregt hat, ist der IBM Framework zur Absicherung generativer KI. Es organisiert die Sicherheit rund um das gesamte KI-Wertstrom und deckt Systeme, Datenflüsse und Betriebsprozesse ab, die das Modell umgeben.

Das Framework organisiert die generative KI-Sicherheit in fünf Ebenen, die verschiedenen Teilen des KI-Lebenszyklus zugeordnet sind.

1. Sicherheit der Daten

Die erste Ebene konzentriert sich auf den Schutz vertraulicher Informationen während des gesamten KI-Lebenszyklus. Unternehmen zentralisieren häufig große Datensätze, wenn sie Informationen für generative Modelle trainieren, optimieren oder abrufen. Diese Konzentration von Daten erhöht die Auswirkungen potenzieller Sicherheitslücken.

Zu den wichtigsten Sicherheitsvorkehrungen gehören:

- Datenermittlung und -klassifizierung zur Identifizierung sensibler Datensätze, die während des Trainings oder Abrufs verwendet werden.

- Verschlüsselung und Schlüsselmanagement zum Schutz von Daten sowohl bei der Speicherung als auch bei der Übertragung.

- Zugriffskontrollen und Identitätsmanagement, um einzuschränken, wer mit Trainingsdaten, Einbettungen und Protokollen interagieren kann.

Zusammen reduzieren diese Vorschriften das Risiko, dass sensible Daten während der Entwicklung und Produktion preisgegeben werden.

2. Sicherheit modellieren

Die Modellsicherheit befasst sich mit der Integrität von Modellartefakten und den Prozessen, mit denen sie trainiert und bereitgestellt werden.

Die meisten Organisationen verlassen sich auf vortrainierte Modelle, die von offenen Repositorys oder externen Anbietern stammen. Dies birgt Risiken in der KI-Lieferkette, einschließlich der Möglichkeit, dass Modell-Checkpoints kompromittiert oder Trainingsdaten verfälscht werden.

Zu den wichtigsten Steuerelementen gehören:

- Überprüfung der Herkunft und Integrität von Modellartefakten

- Modellabhängigkeiten und Gewichte vor der Bereitstellung scannen

- Sicherung der API-Schnittstellen, die für den Zugriff auf gehostete Modelle verwendet werden

Sie stellen sicher, dass das Modell selbst nicht manipuliert wurde, bevor es in die Produktionsumgebung gelangt.

3. Sicherheit bei der Nutzung

Die Nutzungssicherheit konzentriert sich auf das Laufzeitverhalten generativer KI-Systeme. In dieser Phase interagieren die Modelle mit Eingabeaufforderungen, externen Datenquellen und möglicherweise Unternehmenstools. Auf dieser Ebene werden Bedrohungen wie Prompt-Injection oder Modellextraktion abgewehrt.

Unternehmen implementieren diese Kontrollen in der Regel, um sicherzustellen, dass Modelle sicher funktionieren, wenn sie realen Eingaben ausgesetzt sind:

- schnelle Überwachung und Eingabevalidierung

- Ratenbegrenzung und Abfragesteuerung zur Verhinderung von Modellmissbrauch

- Systeme zur Laufzeitüberwachung, die verdächtige Nutzungsmuster oder potenzielle Datenlecks erkennen

4. Sicherheit der Infrastruktur

Generative KI-Systeme basieren letztlich auf traditioneller Infrastruktur, einschließlich Cloud-Diensten, Identitätssystemen und Netzwerkkonnektivität.

Die Infrastruktursicherheit konzentriert sich darauf, sicherzustellen, dass die Umgebung, die KI-Workloads unterstützt, etablierten Cybersicherheitsprinzipien folgt.

Zu den wichtigsten Steuerelementen gehören:

- Netzwerksegmentierung zwischen KI-Diensten und sensiblen Systemen

- verschärfte Richtlinien für Identitäts- und Zugriffsmanagement

- sichere Containerisierung oder Virtualisierung für die Modellausführung

Die Anwendung traditioneller Infrastrukturkontrollen ist nach wie vor eine der effektivsten Methoden, um den Explosionsradius von KI-bedingten Vorfällen zu verringern.

5. Operative Unternehmensführung

Die letzte Ebene befasst sich mit der laufenden Verwaltung von KI-Systemen nach der Bereitstellung. Im Gegensatz zu herkömmlicher Software können sich KI-Modelle im Laufe der Zeit aufgrund von Datenabweichungen oder sich ändernden Nutzungsmustern verschlechtern.

Diese Ebene stellt sicher, dass KI-Systeme auf ihren beabsichtigten Zweck ausgerichtet bleiben, wenn sich die Umgebungen weiterentwickeln. Die operative Steuerung umfasst:

- Überwachung der Modellleistung und Verhaltensänderungen

- Prüfung der Ergebnisse auf Vorurteile, Sicherheits- und Compliance-Probleme

- Pflege der Dokumentation und Überwachung im Einklang mit regulatorischen Rahmenbedingungen wie dem EU-Gesetz über künstliche Intelligenz

IBM Framework im Vergleich zu OWASP

Dolmetschen von Führungskräften

Einer der praktischen Vorteile des IBM-Frameworks besteht darin, dass es Unternehmen dabei hilft, die Verantwortlichkeiten im Bereich KI-Sicherheit so zu strukturieren, dass sie mit der bestehenden Unternehmensführung übereinstimmen. Auch ohne die Einführung IBM-spezifischer Tools kann das Modell als einfache Betriebsstruktur verwendet werden.

Zum Beispiel:

Eigentümerschaft pro Ebene zuweisen

Definieren Sie klare Verantwortlichkeiten für jede Ebene — Datenplattformteams für Datensicherheit, Identitätsteams für die Zugriffskontrolle und Anwendungsteams für die Laufzeitüberwachung.

Budget nach Kontrollbereich

Sicherheitsinvestitionen können bestimmten Kontrollbereichen wie Identitätssicherung, Datenschutz und Überwachung der Infrastruktur zugeordnet werden, anstatt vagen „KI-Initiativen“.

Pflegen Sie ein einheitliches Risikoregister

Die Zuordnung von KI-Systemen zu diesen Ebenen ermöglicht es Unternehmen, Risiken, Abhilfemaßnahmen und betriebliche Verantwortlichkeiten in einer einzigen Verwaltungsstruktur zu verfolgen.

Wichtige Einschränkung

Ein Framework beseitigt nicht die zugrunde liegende technische Herausforderung der generativen KI. Große Sprachmodelle können nicht zuverlässig zwischen vertrauenswürdigen Anweisungen und nicht vertrauenswürdigen Daten unterscheiden. Dies hat zur Folge, dass Angriffe wie Prompt Injection allein durch Filter oder Leitplanken nicht vollständig verhindert werden können.

Aus diesem Grund behandeln etablierte Unternehmen Frameworks als Verwaltungsstrukturen und verlassen sich gleichzeitig auf architektonische Kontrollen und Ausführungsgrenzen, um die potenziellen Auswirkungen der Modellmanipulation zu begrenzen.

Fazit

Wenn Unternehmen beginnen, KI-Systeme einzusetzen, die Maßnahmen ergreifen können, muss sich auch die Sicherheit weiterentwickeln. Die Priorität besteht nicht darin, Risiken zu eliminieren, sondern sicherzustellen, dass KI-Systeme innerhalb klar definierter Grenzen funktionieren. Dies erfordert einen Überblick darüber, worauf Agenten zugreifen können, welche Aktionen sie ausführen können und wie diese Aktionen überwacht werden.

Die Festlegung expliziter Systemgrenzen, die Kontrolle der Verbreitung nicht genehmigter KI-Tools, die Isolierung von Vorgängen mit hohem Risiko und die Aufrechterhaltung einer detaillierten Beobachtbarkeit sind grundlegende Schritte. Die Anpassung dieser Praktiken an anerkannte Rahmenbedingungen stärkt die Unternehmensführung und die Rechenschaftspflicht weiter.

Durch die Anwendung von Prinzipien wie strengen Ausführungskontrollen können Unternehmen agentische KI verantwortungsbewusst skalieren und gleichzeitig die in Produktionsumgebungen erwartete Sicherheit und Zuverlässigkeit aufrechterhalten.

.avif)

Heading 1

Heading 2

Heading 3

Heading 4

Heading 5

Heading 6

Lorem ipsum dolor sit amet, consectetur adipiscing elit, sed do eiusmod tempor incididunt ut labore et dolore magna aliqua. Ut enim ad minim veniam, quis nostrud exercitation ullamco laboris nisi ut aliquip ex ea commodo consequat. Duis aute irure dolor in reprehenderit in voluptate velit esse cillum dolore eu fugiat nulla pariatur.

Block quote

Ordered list

- Item 1

- Item 2

- Item 3

Unordered list

- Item A

- Item B

- Item C

Bold text

Emphasis

Superscript

Subscript

.avif)